2026 年 4 月 13 日,UK AI Safety Institute (AISI) 发布了对 Claude Mythos Preview 的评估——该模型仅在数天前的 4 月 7 日才正式发布——评估基于一次名为 “The Last Ones” (TLO) 的 32 步企业攻击模拟,这一场景由人类专家执行大约需要二十小时。

该模型平均完成了 32 步中的 22 步,并在 10 次尝试中有 3 次端到端地走完了整条攻击链。这是有史以来第一个做到这一点的模型。

上一代模型(Opus 4.6)平均仅完成 16 步,且从未真正走完整条攻击链。

AISI 研究中有四个数据值得细细品味:

73% 这一数字之所以重要,是因为在 2025 年 4 月之前,没有任何模型能够完成专家级 CTF。在不到一年的时间里,这一情况就从“零能力”变成了“及格通过”。

最后一个数字最令人警觉。性能随推理算力呈对数线性增长——而 AISI 观察到尚未出现平台期。更多的钱、更多的时间、更多的 token,就带来更强的能力。目前还看不到任何架构层面的天花板。

Mythos 报告并非个例。多个独立机构在同一季度得出了相同的结论:

| 来源 | 结论 |

|---|---|

| International AI Safety Report 2026 | “当前的 AI 系统已经能够自主完成网络攻击中涉及的某些任务。”并记录了一起真实事件。 |

| UK NCSC | 前沿 AI 的进攻能力正以每 4 个月翻倍的速度增长。 |

| Malwarebytes 2026 Predictions | “完全自主的勒索软件流水线”使得小型团伙也能同时攻击大量目标。 |

| PentestGPT v2 (学术研究) | 在 HackTheBox Season 8 中完成率达 76.9%——位列全球 8,036 名活跃参赛者中的前 100 名。 |

| Hadrian 调查 | 截至 2026 年 3 月,已有 70 款开源 AI 渗透测试工具被收录——其中 65 款是在过去 18 个月内发布的。 |

五个不同的视角——来自政府、学术界、商业界、威胁情报——无一例外地都指向同一个方向。

NCSC 的这一评估容易被一眼带过。但不应被忽视。按这一速率复利增长,数字会变成防御者必须严肃对待的量级:

如果这一趋势延续,今天 AI 代理需要 8 小时才能利用的漏洞,两年后只需 7.5 分钟。与此同时,企业打补丁周期仍以周为单位衡量,而漏洞披露到被利用之间的时间窗口,已经在缩短到人类根本无法响应的程度。

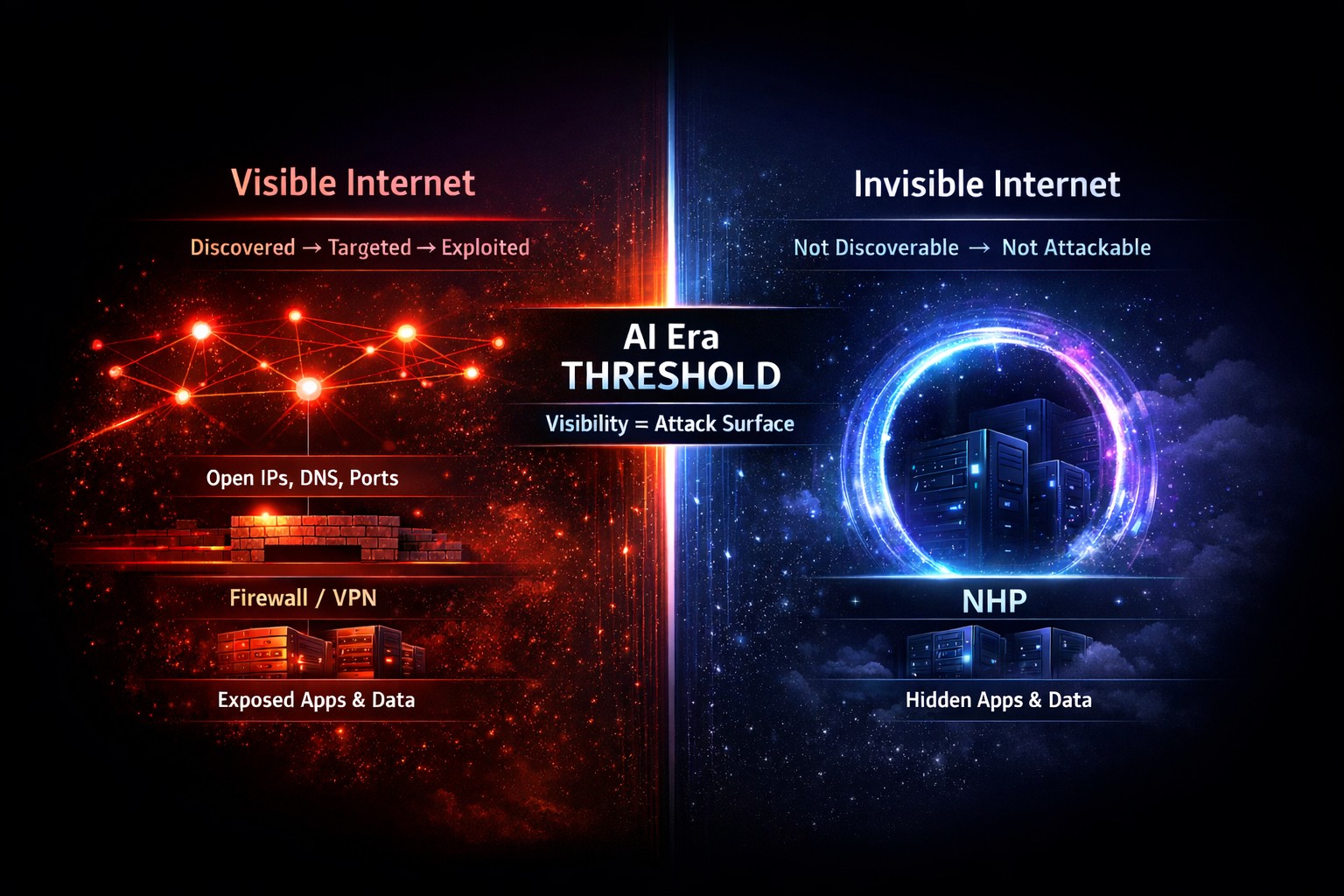

现代安全堆栈——TLS、WAF、防火墙、EDR、SIEM——都建立在一个根本假设之上:服务是可见的,防御从握手开始。你暴露一个端口,你发布一条 DNS 记录,你终止 TLS,然后再做身份认证。

这套堆栈的每一层都默认前面这三件事是公开的。对于以人类速度行动的攻击者来说,这尚可容忍——侦察有成本,指纹识别也需要付出努力。

但对于 7×24 不眠不休、token 成本几乎可以忽略的 AI 代理来说,这种可见性就是攻击面。每一个开放端口都是免费情报,每一条 DNS 记录都是一张地图,每一份 TLS 证书都在泄露元数据。AI 无需击败那把锁——它并行研究图纸、入住时间表、供应链以及厂商的补丁历史,然后挑选你最脆弱的时刻出手。

零信任正确地否定了内网隐式信任这一观念。以身份为核心的认证、持续校验、最小权限——这些都是真正的进步,OpenNHP 并不取代它们。

但大多数零信任部署仍然先开门再看是谁在敲门。服务是可达的,端口有响应,TLS 握手能完成。身份认证发生在建立连接之后。

在以人类速度为主的威胁时代,这样的顺序没什么问题。但在自主 AI 速度的时代,这意味着攻击者可以在任何凭据检查之前进行探测、指纹识别、枚举和模糊测试。这意味着它们可以找到那个能够直接绕过凭据检查的漏洞——正是 Claude Code Security 工作所证明 AI 如今能够大规模发现的那类缺陷。

我们此前在 《互联网正在变成一片黑暗森林》中写过这一论点。AISI 的数据把这一论点从文学隐喻变成了工程上的硬性要求。

在黑暗森林中,每一丝声响都会暴露位置,每一束光都会招来猎手。在 AI 时代的互联网上,每一个暴露的端口都会暴露一个目标,每一条公开的 DNS 记录都会吸引自动化侦察。

| 黑暗森林 | AI 时代的互联网 |

|---|---|

| 光 | 开放端口 |

| 声响 | IP 地址 |

| 信号 | DNS 记录 |

| 猎手 | 自主 AI 代理 |

完整的论述可见于 愿景 页面。一句话总结:

OpenNHP——网络基础设施隐身协议(Network-infrastructure Hiding Protocol)——在会话层实现了黑暗森林式防御:

- 在 TCP 握手之前完成密码学敲门。未经身份验证的请求得不到 SYN-ACK,甚至连 ICMP 不可达响应都得不到。服务不是被“过滤”,而是与不存在毫无区别。

- 对未授权 DNS 返回 NXDOMAIN。没有有效身份证明的客户端得到的回答,与查询一个根本不存在的域名得到的回答完全一样。没有指纹,没有元数据,没有攻击面。

- 每一层都默认拒绝。域名、IP 和端口全部处于隐身状态,直到通过现代密码学(Noise Protocol、Curve25519、ChaCha20-Poly1305)证明身份为止。

- 无状态且可扩展。基于内存安全的 Go 构建,基准测试每秒 1 万次身份验证请求,延迟低于 10 毫秒——隐身不会以性能为代价。

当一个自主 AI 代理扫描受 OpenNHP 保护的环境时,它的侦察得不到任何可以作为跳板的信息。那条 32 步的 TLO 攻击链会在第一步就断掉,因为第一步就要求找到可以攻击的目标。而这里什么也找不到。

协议细节请参阅 规范 页面。该草案正在 IETF 进行标准化,并被 Cloud Security Alliance 的会话层零信任指南所引用。

OpenNHP 是开源协议。部署一个协议仍然意味着要运行服务器、管理密钥、集成客户端。对于需要黑暗森林式防御但又不想承担这些运维负担的团队来说,来自 LayerV 的 Qurl 就是直接构建于 OpenNHP 之上的产品——开箱即用。

Qurl 的口号精准地概括了这一论点:

只需一次 API 调用,Qurl 就能为你的服务器、API 和管理界面签发限时、自毁的访问链接。只要这些链接尚未被出示,底层基础设施对扫描器、爬虫和 AI 代理都是不可见的。TLO 攻击链的侦察步骤什么也拿不到,因为根本没有东西可以返回。

- 开箱即用的 NHP 防御——无需额外的协议集成工作

- 临时访问——每条链接都有有效期,会自动撤销

- API 优先——一次调用即可接入现有的 CI/CD、客服支持或管理员工作流

- 底层即 OpenNHP——同一套进入标准化流程的密码学基础,同样的隐身保证

如果 NCSC 观察到的翻倍趋势延续,从“AI 已经令人担忧地擅长这件事”到“AI 以廉价、7×24 的方式大规模自主完成这件事”之间的距离,只能用个位数的季度来衡量。

由此可以得出三个结论:

- 可见性不再是一个中性的默认选项。每一个暴露面,都是给自动化攻击者的一份补贴。

- 仅靠检测与响应无法扩展。你无法靠堆人力去匹配一个运行成本只需 0.50 美元/小时的攻击代理。

- 网络隐身将成为架构基线。它不是小众控制措施,也不是高级付费功能——它是默认项。

OpenNHP 是其中一个答案。它是开源的、走标准化路线的,并且如今就可以部署。防御方的算术只有在我们改变输入条件时才走得通——而我们能控制的唯一输入,就是我们暴露出多少自己。